Mats G

Aktiv medlem

En (1) pixel är väl den minsta enheten i en digital bild.

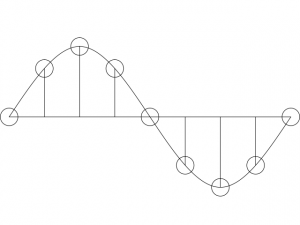

Jag funderar på är hur då i ex. Ps kan lägga skärpa med radie mindre än en pixel (Typ, skärpa för webb, radie 0,5 px mängd 100%).

Finns det halva pixlar?

Detta är ju "onödigt vetande", men sånt som man kan komma att fundera på...

Jag funderar på är hur då i ex. Ps kan lägga skärpa med radie mindre än en pixel (Typ, skärpa för webb, radie 0,5 px mängd 100%).

Finns det halva pixlar?

Detta är ju "onödigt vetande", men sånt som man kan komma att fundera på...